텍스트·이미지·음성·영상을 넘나든다 ‘멀티모달 AI의 시대’

지난주 우리는 파인튜닝과 프롬프팅, 인공지능(AI)을 내 것으로 만드는 두 가지 전략을 비교했다. AI 뇌를 바꾸느냐, AI와 소통하는 방식을 바꾸느냐의 차이였다. 그렇다면 이런 의문이 생길 수 있다. “지금까지는 주로 텍스트로 AI와 대화했는데, AI가 눈으로 보고, 귀로 듣고, 영상까지 이해할 수 있다면 어떻게 달라질까?” 오늘은 AI가 단순히 글을 읽고 쓰는 수준을 넘어, 사진을 보고, 말을 듣고, 영상을 분석하는 ‘멀티모달(Multimodal) AI’의 영역으로 들어가 보고자 한다.

AI에게 눈과 귀, 그리고 영상 감각이 생겼다

멀티모달(Multimodal)이란 ‘여러 가지 양식(modality)’을 뜻한다. 기존 AI가 텍스트라는 단 하나의 통로로만 세상과 소통했다면, 멀티모달 AI는 텍스트·이미지·음성·영상을 동시에 받아들이고 처리한다.

비유를 들자면, 지금까지의 AI는 눈을 가리고, 귀를 막은 채 손으로 점자만 읽는 사람과 같았다. 텍스트라는 제한된 채널로만 세상을 인식했기 때문이다. 상대적으로 멀티모달 AI는 눈을 뜨고, 귀를 열고, 화면까지 보기 시작한 것이다. 같은 사건을 이해하고자 할 때 글만 읽고 이해하는 것과 눈으로 보고 귀로 듣고 이해하는 것의 차이는 분명히 다르기 때문이다.

현재 대표적인 멀티모달 AI로는 OpenAI의 GPT-4o, Google의 Gemini 1.5 Pro, Anthropic의 Claude 3.5 Sonnet 등이 있다. 이들은 이미 이미지·음성·영상 입력을 모두 지원하며, 실시간 대화까지 가능한 수준에 이르렀다.

네 가지 감각들은 어떻게 작동하는가?

멀티모달(Multimodal) AI가 처리하는 네 가지 주요 입력 방식을 살펴보자.

첫째, 텍스트(Text) 즉, 문자는 여전히 AI의 가장 강력한 토대이며, 산업 전영역에서 널리 활용된다. 모든 멀티모달 처리의 중심에는 언어 모델이 있으며, 다른 양식들도 결국 텍스트로 변환되거나 텍스트와 결합 되어 처리된다.

둘째, 이미지(Image) 처리다. AI는 이제 사진 한 장을 보고 제품 불량을 잡아내고, X레이를 분석해 이상 소견을 찾아내며, 사용자가 찍은 식물 사진을 보고 병충해를 진단한다. 단순히 “이 사진에 뭐가 있어?”를 넘어, 이미지 속 맥락과 감정, 디자인의 완성도까지 평가할 수 있다. 대표적인 적용 분야는 의료·제조·커머스 등이며, 데이터 처리량은 중간 수준이다.

셋째, 음성(Voice) 처리다. AI가 사람의 말을 듣고 텍스트로 바꾸는 것(STT)은 이미 익숙하다. 그러나 최신 멀티모달 AI는 한 걸음 더 나아가 억양, 감정, 말의 빠르기까지 분석한다. 콜센터에서 고객의 목소리 톤만으로 불만 수위를 감지하고 대응 전략을 바꾸는 것이 가능해졌다. 금융 및 서비스 분야에 많이 활용된다.

넷째, 영상(Video) 처리는 멀티모달의 최전선이라 할 수 있다. 영상은 ‘시간이 흐르는 이미지의 연속’이다. AI가 영상을 이해한다는 것은 단순히 한 장면을 보는 것이 아니라, 장면과 장면 사이의 맥락 변화, 행동의 흐름, 화자의 감정 변화를 연속적으로 추적한다는 의미다. Google Gemini 1.5 Pro는 최대 1시간 분량의 영상을 통째로 분석해 핵심 내용을 요약하거나 특정 장면을 찾아낼 수 있고 한다. 이 영역은 지금 빠르게 성장하고 있으며, 교육, 보안, 스포츠 분야 등이 대표적인 적용 분야라 할 수 있다.

이들 멀티모달 AI 기능은 이미 산업현장에서 널리 사용되고 있는데, 몇 가지 활용사례를 살펴보면 아래 예와 같다.

제조업의 이미지·영상 결합 품질 검사

자동차 부품 제조사 K는 딥러닝 기반 비전 검사 방안을 제안한 특정 스타트업의 멀티모달 AI를 생산 라인에 도입했다. 카메라로 부품 이미지를 실시간 촬영하고, AI가 미세한 스크래치나 치수 불량을 0.1초 이내에 감지한다. 여기서 끝이 아니다. 영상 분석 기능을 추가해 불량이 발생하는 공정 단계를 역으로 추적, 어느 순간 어떤 동작에서 결함이 생겼는지를 영상 흐름으로 찾아낸다. 그 결과 결함 발생 빈도가 눈에 띄게 급감하여 품질 관리 비용을 크게 절감했다.

교육 현장의 영상 분석 AI

국내 한 에듀테크 기업은 온라인 강의 영상을 멀티모달 AI로 분석하는 서비스를 출시했다. AI는 강사의 말투, 판서 내용, 학생의 표정 변화(화상 수업의 경우)를 종합 분석해 이해도가 떨어지는 찰나의 순간을 놓치지 않고 분석 리포트에 반영함으로써 해당 개념에 추가 설명이 필요합니다“라고 피드백을 해준다. 영상, 음성, 텍스트(자막) 세 가지를 동시에 처리한 결과다.

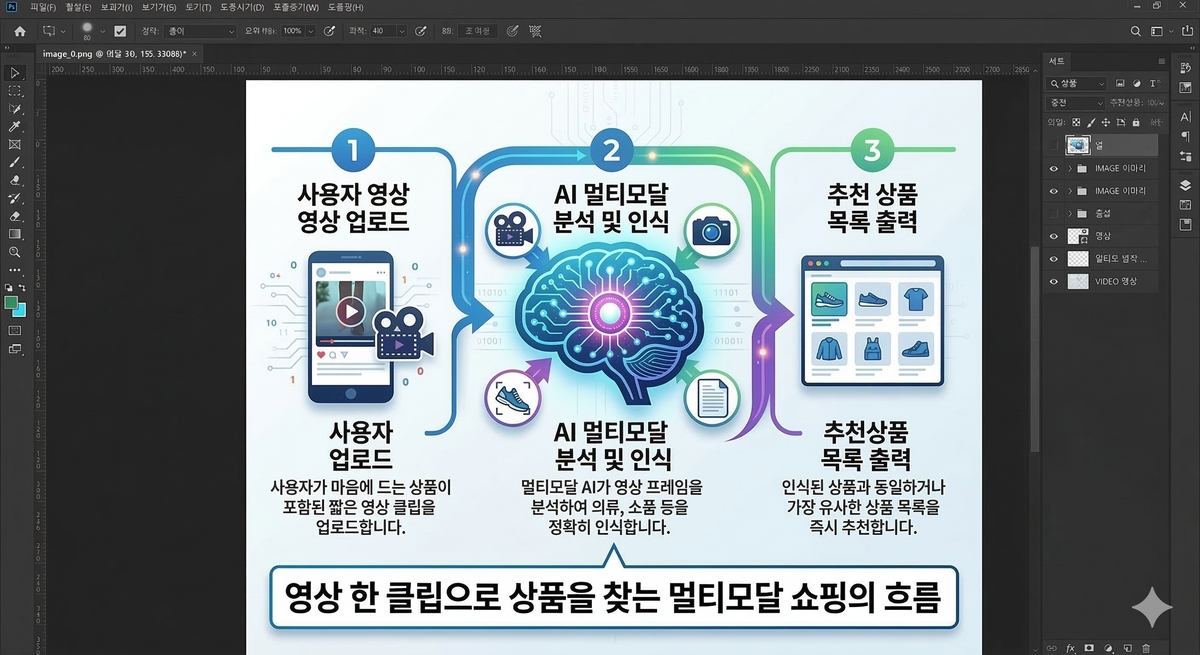

유통·커머스의 멀티모달 쇼핑 경험

국내 한 대형 쇼핑 플랫폼은 ‘사진으로 찾기’를 넘어 ‘영상으로 찾기’ 기능을 도입했다. 소비자가 인플루언서 영상에서 마음에 드는 장면을 캡처하거나 짧은 영상 클립을 올리면, AI가 영상 속 의류·소품을 인식해 동일하거나 유사한 상품을 즉시 추천한다. 검색에 소요되는 불필요한 과정을 획기적으로 줄여 쇼핑의 피로도를 낮췄다.

나는 어디서부터 시작해야 할까?

멀티모달(Multimodal) AI 활용을 처음 시작한다면 세 가지 진입점을 추천한다.

가장 쉬운 시작은 이미지 분석이다. ChatGPT나 Claude에 사진을 첨부해 “이 계약서 사진에서 주요 조항을 정리해 줘”, “공장 사진에서 안전 위반 사항이 있는지 점검해 줘”처럼 활용해 보라. 별도 투자 없이 지금 당장 가능하다.

다음은 음성 연동이다. 회의 녹음 파일을 AI에 넣어 요약·분석하거나, 고객 상담 음성 데이터에서 주요 불만 유형을 자동 분류하는 것이 대표적 활용이다.

가장 고도화된 단계는 영상 분석 파이프라인 구축이다. n8n 같은 자동화 도구와 Gemini API를 연동하면, 영상이 업로드되는 순간 자동으로 분석 결과가 문서로 저장되는 워크플로우를 만들 수 있다. 교육 기관이나 제조업체에서 특히 즉각적인 효과를 볼 수 있다.

경계가 무너지고 있다 - 멀티모달의 미래

멀티모달 AI의 진화 방향은 명확하다. 실시간성과 통합성이다. OpenAI의 GPT-4o는 이미 화상 통화 중 상대방의 표정을 읽고 감정에 맞는 답변을 하는 수준에 도달했다. Google의 Project Astra는 스마트폰 카메라가 비추는 실시간 영상을 AI가 보면서 대화하는 ‘눈이 달린 AI 비서’를 현실화했다.

한국에서도 변화가 빠르다. 네이버의 하이퍼클로바X, 카카오의 KoGPT 모두 이미지·음성 처리를 통합하는 방향으로 업그레이드 중이다. 2026년 이후에는 텍스트 AI와 멀티모달 AI를 굳이 구분할 필요조차 없어질 것이라는 전망이 지배적이다.

결국, 멀티모달(Multimodal) AI는 인간이 세상을 인식하는 방식, 즉 보고 듣고 읽고 느끼는 방식을 AI가 따라오고 있다는 신호다. AI에게 글만 주던 시대는 끝나가고 있다. 이미지를 찍고, 목소리를 담고, 영상을 보여주며 AI와 협업하는 시대가 지금 열리고 있다. 다음 주에는 개발 코드(Code)를 공유하는 오픈소스 AI와 그렇지 않은 클로즈드 AI의 전략 전쟁, LLaMA, GPT, Claude가 서로 다른 길을 걷는 이유와 우리에게 미치는 영향을 살펴보자.

/서용운 계명대 글로벌 창업대학원 벤처창업학과 교수